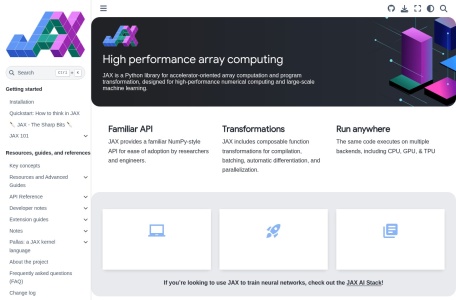

JAX 是什么?

JAX 是 Google 推出的高性能数值计算库,提供类似 NumPy 的 API,支持 GPU/TPU 加速、自动微分(jax.grad)、即时编译(jax.jit)和向量化(jax.vmap)。通过 XLA 编译器优化代码,JAX 能显著提升大规模数据处理和机器学习任务的运行效率。其异步执行模式和不可变数组设计,兼顾性能与可靠性,是现代科学计算和深度学习研究中的重要工具。

官网地址: https://jax.readthedocs.io/

一、核心功能

1. 自动微分(Automatic Differentiation)

使用 jax.grad 可轻松计算标量函数的梯度,并支持高阶导数(jax.hessian)。这对于优化算法(如梯度下降)和训练神经网络至关重要,且代码比手动求导更简洁可靠。

2. 即时编译(JIT, Just-In-Time Compilation)

通过 jax.jit 装饰器,JAX 会将 Python 函数编译成 XLA 优化的机器码。首次调用后后续执行速度大幅提升,尤其适合循环、矩阵运算等计算密集型任务,加速效果可达数十倍。

3. 向量化(Vectorization)

jax.vmap 可以自动将函数映射到批量数据上,避免手动编写循环。例如,原本只能处理单个样本的函数,经过 vmap 后可直接接受批次输入,既简化代码又保持高效。

4. 并行化(Parallelization)

jax.pmap 支持跨多个设备(CPU、GPU、TPU)的数据并行。只需一行代码,即可将计算任务分发到所有可用硬件上,实现高效的分布式训练或大规模模拟。

5. 硬件加速

JAX 原生支持 CPU、GPU 和 TPU 后端,无需修改代码即可在不同硬件上运行。利用 XLA 的跨平台优化,JAX 能充分发挥加速器的并行计算能力。

6. 程序变换(Program Transformation)

除了 grad、jit、vmap、pmap,JAX 还提供 jax.lax 模块(低阶操作)和 jax.custom_vjp(自定义梯度),允许开发者构建复杂的程序逻辑,灵活扩展。

7. 函数式纯函数设计

JAX 鼓励编写无副作用的纯函数,数组不可变(类似 NumPy 但返回新数组)。这避免了意外修改,使代码更易调试、推理和并行化。

二、使用方法

环境准备与安装

conda create -n jax_env python=3.13 -y conda activate jax_env pip install jupyter numpy "jax[cuda12]" matplotlib pillow

(根据硬件选择 CPU、CUDA 或 TPU 版本,具体参考官方文档)

自动微分示例

import jax import jax.numpy as jnp def cubic_sum(x): return jnp.sum(x**3) grad_fn = jax.grad(cubic_sum) x = jnp.arange(1.0, 5.0) print(grad_fn(x)) # [ 3. 12. 27. 48.]

即时编译示例

@jax.jit def selu(x): return 1.0507 * jnp.where(x > 0, x, 1.67326 * jnp.exp(x) - 1.67326) data = jnp.random.normal(jax.random.PRNGKey(0), (10000, 10000)) result = selu(data) # 第一次编译,后续调用极快

向量化示例

def mat_vec_product(matrix, vector): return jnp.dot(matrix, vector) batched = jax.vmap(mat_vec_product, in_axes=(None, 0)) matrix = jnp.random.normal(jax.random.PRNGKey(0), (10000, 10000)) vectors = jnp.random.normal(jax.random.PRNGKey(1), (128, 10000)) output = batched(matrix, vectors) # 一次处理128个向量

三、适用人群与应用场景

适用人群

机器学习研究员:需要快速试验新算法(如神经网络、强化学习),自动微分和 JIT 加速让迭代更快。

科学计算工程师:物理、化学、生物模拟中需要高效求解微分方程、优化参数,JAX 的硬件加速和自动微分是关键。

数据科学家:处理大规模数值数据(图像、信号),利用向量化和并行化加速预处理与特征工程。

金融量化分析师:风险价值计算、期权定价、高频回测等需要大量矩阵运算的场景。

计算生物学家:基因组数据分析、蛋白质折叠预测,借助 TPU 加速实现更高吞吐。

典型应用场景

| 场景 | 说明 |

|---|---|

| 深度学习训练 | 使用 JAX + Flax(神经网络库)构建 Transformer、CNN 等模型,利用 pmap 实现多卡并行训练。 |

| 物理仿真 | 模拟粒子系统或流体力学,通过 jit 编译加速每个时间步的更新,配合 grad 进行参数反演。 |

| 贝叶斯推理 | 结合 NumPyro 或 BlackJAX,利用自动微分和向量化进行高效的 MCMC 采样。 |

| 信号处理 | 对大型音频或图像数组应用滤波、傅里叶变换,vmap 可自动批量处理。 |

| 优化与控制 | 机器人运动规划中,使用 jax.grad 计算目标函数的梯度,结合优化器快速求解。 |

四、核心优势

统一的 NumPy 风格 API:学习成本极低,NumPy 用户可无缝迁移。

硬件无关的性能加速:JIT + XLA 让 Python 代码接近 C++ 速度,且无缝支持 GPU/TPU。

强大的程序变换组合:

grad、jit、vmap、pmap可任意组合,实现自动微分 + 并行 + 向量化。函数式纯编程:避免副作用,代码更易调试和测试,天然支持分布式计算。

与 NumPy 互操作:支持

np.array与jnp.array转换,方便逐步迁移。活跃的生态:Flax、Optax、TensorFlow Probability、DeepMind Haiku 等库基于 JAX 构建,覆盖研究全流程。

五、总结

JAX 代表了下一代数值计算库的方向:它继承了 NumPy 的简洁语法,却通过 XLA 编译、自动微分和程序变换,将性能提升到新高度。对于需要在大规模数据上反复运行复杂模型的科学家和工程师,JAX 是不可多得的利器。其函数式设计也鼓励更规范、更可复现的代码。访问官方文档,通过 pip install jax 开始体验,你会发现同样的算法在 JAX 中往往运行得更快、写得更少。

数据统计

相关导航

Trickle AI

BetterYeah AI

LongCat开放平台

Keras

智谱清流

快马InsCode

LLaMA-Factory Online