Stable Diffusion 是一个开源的AI文本到图像生成模型,基于深度学习技术,主要用于根据文本描述生成详细的图像和插画。该模型于2022年由初创公司Stability AI与慕尼黑大学、Runway等学术研究机构合作开发,代码和模型权重已公开发布。

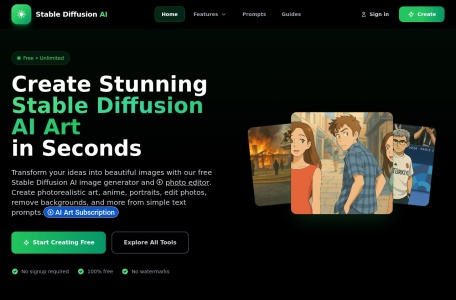

https://stabledifffusion.com/zh

平台定位与核心能力

Stable Diffusion 是一个潜在扩散模型(Latent Diffusion Model),属于深度生成性神经网络的一种。与此前的专有文生图模型(如DALL-E、Midjourney)不同,Stable Diffusion 的代码和模型权重完全开源,用户可以在配备适度GPU的本地电脑硬件上运行,无需通过云计算服务访问。这一特性使其成为AI绘画爱好者和开发者最常用的基础模型之一。

Stable Diffusion 面向AI艺术创作者、设计师、游戏开发者、影视概念设计师、科研人员以及所有对AI生成图像感兴趣的用户。其核心优势在于免费、开源、可本地部署、高度可定制,并拥有庞大的社区生态(如Civitai模型分享平台、各类插件和微调模型)。

主要功能

1. 文本生成图像(文生图)

用户输入文字描述(提示词),模型生成对应的图像。支持正面提示词和负面提示词(排除不希望出现的内容)。可调节参数包括采样步数、引导强度、随机种子等,控制生成结果的多样性和准确性。

2. 图像生成图像(图生图)

用户上传一张初始图片,结合文本提示,生成风格或内容上相关联的新图像。支持调整重绘强度,从轻微修改到大幅改变均可控制。

3. 局部重绘(Inpainting)

用户选择图片中的特定区域,输入新的文本描述,AI只对该区域进行重新生成,保持其他部分不变。适用于修复图片缺陷、替换物体、调整局部细节等场景。

4. 外绘扩展(Outpainting)

向图片的四周(上下左右)扩展画布,AI自动生成与原有画面风格一致的新内容。可用于将方形图扩展为宽幅或竖幅构图。

5. 高清放大与修复

对生成的低分辨率图像进行AI放大,提升清晰度和细节。支持面部修复、整体细节增强等功能。

6. ControlNet等高级控制

通过ControlNet插件,用户可以基于边缘检测、深度图、姿态骨架、语义分割等额外条件精确控制图像的构图和姿态,实现更专业的创作。

在线使用方式(无需本地部署)

DreamStudio:Stability AI官方推出的在线平台,用户注册后可付费使用Stable Diffusion模型,无需安装任何软件,界面友好。

ClipDrop:Stability AI旗下工具平台,提供Stable Diffusion XL等在线生成功能,支持快捷编辑和背景移除。

Stable Artisan:Stability AI在Discord平台推出的机器人服务,用户通过指令生成图像,类似Midjourney的操作方式。

本地部署方式(免费开源)

用户可通过以下工具在个人电脑上免费运行Stable Diffusion:

绘世启动器:B站UP主“秋葉aaaki”制作的Stable Diffusion WebUI启动器桌面版,集成了运行环境、模型管理和常用插件,适合新手一键安装。

Stable Diffusion WebUI:由AUTOMATIC1111开发的开源图形界面,功能最完整,支持多种扩展和模型,是社区最流行的本地部署方案。

ComfyUI:基于节点式工作流的界面,适合需要复杂流程控制的专业用户。

适用场景

艺术创作:插画师、概念艺术家利用AI生成灵感草图或成品图。

游戏开发:快速生成角色立绘、场景概念图、道具图标。

影视与广告:制作分镜预览、风格参考图、海报素材。

电商设计:生成商品背景图、模特换装、营销视觉素材。

科研与教育:研究扩散模型原理、教学AI生成技术。

个人项目:制作头像、壁纸、社交媒体配图。

优势与特色

开源免费:无需付费订阅,代码和模型完全公开。

本地运行:数据不上传云端,保护隐私,可离线使用。

高度可定制:支持多种微调模型(LoRA、DreamBooth)、插件(ControlNet、Tiled Diffusion等)。

社区生态丰富:Civitai等平台提供数万个免费下载的模型和风格预设。

跨平台支持:Windows、macOS、Linux均可运行。

数据统计

相关导航

insMind

堆友AI反应堆

Midjourney

美图设计室

Shotlab-AI视觉创作

造点AI

可灵AI